Martin van Staveren ontving op 4 november de Caroline Award op de Universiteit Twente. Dit is de publieksprijs voor de meest gewaardeerde, inspirerende presentatie tijdens het jaarlijkse Risk & Resilience Festival. De award is vernoemd naar de in 2019 plotseling overleden Caroline Regtuit, geliefd directeur van Professional Learning en Development van de Universiteit Twente en stuwende kracht achter het festival. Met als thema One step ahead with big data deelden meer dan 25 sprekers hun nieuwste inzichten. Martin’s bijdrage ging over de botsing van big data met ethiek, en de verbindende rol die risicoleiderschap daarbij kan spelen. Hieronder volgt een essay van deze prijswinnende bijdrage.

Twee botsende wereldbeelden

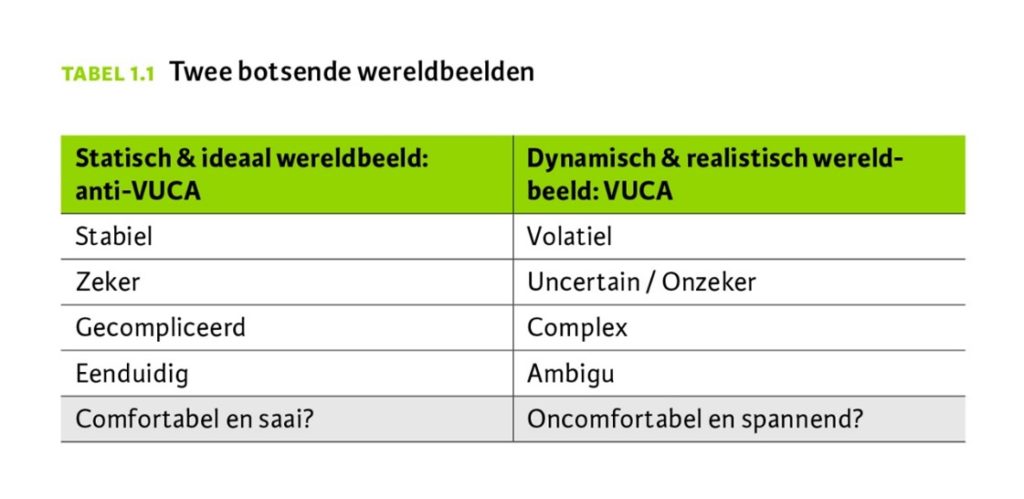

Dagelijks worden we heen en weer geslingerd tussen twee botsende wereldbeelden. Enerzijds leven en werken we in een volatiele, onzekere, complexe en ambigue wereld. Dit wordt wel afgekort tot de VUCA-wereld. Een wereld met volop verrassingen, soms aangenaam, vaak minder aangenaam. Een wereld waarin we ons door allerlei onzekerheden behoorlijk oncomfortabel kunnen voelen. Vooral omdat de wicked problems of wilde vraagstukken van de VUCA-wereld geen eenduidige oplossingen hebben. Er bestaat gewoon geen aanpak waarover iederéén enthousiast wordt. Vrijwel elke organisatie wordt op de een of andere wijze geconfronteerd met componenten van wilde vraagstukken, zoals het klimaatvraagstuk, de coronacrisis of knellende kwesties op het gebied van privacy en veiligheid.

Anderzijds streven we desondanks, misschien wel tegen beter weten in, naar een andere, tegenovergestelde wereld. In deze ideale wereld heerst stabiliteit, zekerheid en eenduidigheid. In deze behoorlijk gecompliceerde wereld zijn de vraagstukken wel eenduidig oplosbaar, ofwel tam in plaats van wild. We hebben hiervoor de laatste tientallen jaren allerlei soorten management ontwikkeld. Zo beloven strategisch management, operationeel management, performance management, veiligheidsmanagement, kwaliteitsmanagement en ook risicomanagement allemaal vormen van stabiliteit, zekerheid en eenduidigheid. De laatste jaren komt daar een ontelbaar aantal algoritmes bij. Die algoritmes zouden verder zouden moeten bijdragen aan die voorspelbare en daarmee maakbare, stabiele wereld, op basis van een continue stortvloed aan gegevens: big data.

Onderstaande tabel 1.1 komt uit het boek Iedereen risicoleider. In de tabel staan beide wereldbeelden broederlijk naast elkaar, terwijl ze in de praktijk nogal eens botsen. Bijvoorbeeld omdat er verwoede en tegelijkertijd vergeefse pogingen worden gedaan om de wilde realiteit van de VUCA-wereld om te vormen tot een maakbare realiteit. Big data wordt dan ingezet om onvoorspelbaarheid en complexiteit te beheersen. Iets wat in veel gevallen een illusie blijkt, zoals we sinds het begin van de coronacrisis continu met elkaar ervaren.

Het enorme belang van feitelijke data

We kunnen dus met een ongerust gevoel constateren dat we leven en werken in een wicked world, terwijl we streven naar een beheersbare, maakbare wereld. Ook al blijft die ideale wereld een illusie, kennis van feitelijke data kan ons wel degelijk een eind op weg helpen. Het enorme belang van feiten voor een realistisch wereldbeeld is door de Zweedse gezondheidswetenschapper Hans Rosling beschreven in zijn levenswerk Feitenkennis. Zijn missie is ‘to fight devastating ignorance with a fact-based worldview.’ Vrij vertaald is dit het vechten tegen een verwoestende en onbewuste onwetendheid met een op feiten gebaseerd wereldbeeld.

Hans Rosling stelde gedurende tientallen jaren allerlei feitelijke vragen aan duizenden mensen over de hele wereld. Een voorbeeld van zo’n vraag: Hoe heeft het aantal doden per jaar door natuurrampen zich de afgelopen 100 jaar ontwikkeld? Dit zijn drie mogelijke antwoorden, waarvan er één feitelijk juist is:

- Meer dan verdubbeld

- Ongeveer hetzelfde gebleven

- Meer dan gehalveerd

Het feitelijk juiste antwoord is antwoord 3. Sterker nog, het aantal doden door overstromingen, aardebevingen, vulkaanuitbarstingen of bosbranden is de afgelopen 100 jaar veel meer dan gehalveerd. Het aantal slachtoffers door natuurrampen is met maar liefst 75 procent afgenomen.

Uit deze en de talloze andere antwoorden op soortgelijke vragen volgt één opvallend en uiterst relevant feit. Dat zit zo. Helemaal blanco, zonder enige kennis van zaken, zou 33 procent van de ondervraagden het juiste antwoord moeten geven. Hans Rosling haalt in zijn boek als voorbeeld chimpansees aan. Als die bovenstaande vraag voorgeschoteld zouden krijgen, en bijvoorbeeld stenen naar de juiste antwoorden zouden moeten gooien, dan zou 33 procent van de chimpansees het juiste antwoord kiezen. Dit is dan puur op basis van toeval, ervan uitgaande dat de chimpansees geen kennis en ook geen aannames over het aantal slachtoffers door natuurrampen hebben. Wereldwijd blijkt echter slechts 10 procent van de ondervraagde mensen het juiste antwoord te geven. En daarbij maak het niet uit wie je het vraagt. Zelfs bezoekers van het World Economic Forum, niet de minst geïnformeerde mensen, scoorden ook ruim onder de 33 procent.

Antwoorden die negatiever zijn dat je op basis van louter toeval mag verwachten zijn niet alleen gegeven voor de specifieke vraag uit het voorbeeld. Het blijkt het geval te zijn voor talloze andere feitelijke vragen, over bijvoorbeeld welvaartsontwikkeling, bevolkingsgroei, onderwijs, gezondheid, geweld en het milieu. We hebben als mensheid dus collectief een aanzienlijk negatiever beeld over tal van ontwikkelingen dan feiten aantonen. Volgens Rosling komt dit door de evolutionaire werking van ons brein, dat nog steeds is ingesteld op het vermijden van onmiddellijk gevaar en zich daarom focust op het negatieve.

Deze negatieve vertekening of bias van de realiteit leidt bijvoorbeeld tot irrationele angsten. Die kunnen op zijn beurt weer leiden tot overdreven dure risicobeheersmaatregelen. Goedbedoelde maatregelen, die ons als mensheid echter niet verder helpen én ons afhouden van andere maatregelen waar we wel wat aan hebben. De conclusie die we uit het levenswerk van Hans Rosling kunnen trekken is dus helder: feitelijke data verzamelen en benutten is essentieel om onwetendheid en een negatieve bias te vermijden, of in elk geval te beperken. Je zou dus denken: hoe meer data, hoe beter.

Data als doorgeslagen panacee

Alleen, is dat wel zo, hoe meer data, hoe beter? Iemand die hier lijnrecht tegenin gaat is filosoof Miriam Rasch. Met haar boek Frictie: Ethiek in tijden van dataïsme heeft zij net als Hans Rosling een missie. Zij benadert data echter vanuit een tegenovergestelde richting en bindt de strijd aan met doorgeschoten data-geloof. In de woorden van Miriam Rasch:

‘Dataïsme is het geloof dat alles te vertalen is in data. Data leggen de wereld vast en maken haar beheersbaar. Maar voor wie en met welk doel? De onderliggende aannames van het dataïsme staan zelden ter discussie. Is de mens echt als algoritme te begrijpen? Wat gebeurt er met dingen die niet in data zijn te vatten?’

Dataïsme ontleent z’n hedendaagse gezag aan het vermeende vermogen tot voorspellen. Dit zou de wereld voor ons allemaal beter, comfortabeler, gemakkelijker moeten gaan maken. Denk bijvoorbeeld aan het betrouwbaarder kunnen voorspellen van het optreden van risico’s, die zo beter beheersbaar zouden kunnen worden. Maar Miriam Rasch verzet zich tegen dergelijke tech for good veronderstellingen. Volgens haar visie begeleiden data en algoritmen ons niet per definitie richting een voorspelbare, maakbare en beheersbare en daarmee automatisch betere wereld. En ze wordt daarin in het gelijk gesteld, zo zal straks blijken uit de casus.

Miriam Rasch pleit daarom voor een herwaardering van frictie of wrijving. Ofwel, voor discomfort en ongemak. Kenmerken die we inmiddels kennen uit de dynamische, onvoorspelbare, ambigue en daarmee onzekere VUCA-wereld. Frictie en het daaruit volgende ongemak zijn namelijk het startpunt voor noodzakelijke ethische reflectie over de data-toepassingen om onzekerheden rücksichtslos te beperken. Voor het verantwoord kunnen omgaan met onzekerheden haalt Rasch een paradoxaal citaat aan, afkomstig van de Franse filosofe Simone de Beauvoir: ‘Sans echec, pas de morale’. Ofwel, zonder mislukking geen moraal. Dit citaat stamt uit 1947 (!) en komt uit het boek Pleidooi voor een moraal der dubbelzinnigheid. Zo arriveren we ook via een ethische route bij de a van ambiguïteit. Welkom terug in de VUCA-wereld.

Waarom speelt onzekerheid een hoofdrol bij ethisch handelen? Omdat elke vraag naar het juiste en daarmee ethische handelen onzekerheid zou moeten veronderstellen over wat juist is. Ethiek wordt zo verbonden met niet (zeker) weten én toch durven handelen. In de woorden van Simone de Beauvoir: ‘Belangrijk is dat de twijfel over wat te doen niet zozeer te maken heeft met de complexiteit […] maar met de fundamentele onoplosbaarheid ervan.’ Denk hierbij weer aan de wilde vraagstukken, waarvoor eenduidige, ultieme oplossingen ontbreken.

Die fundamentele onoplosbaarheid betekent bijvoorbeeld dat consequenties van doen of niet doen nooit 100% zeker zijn. Dit houdt ook in dat het onmogelijk is om alle belangen van iedereen te dienen. ‘De droom van een onmenselijke objectiviteit moeten we laten varen’, aldus Simone de Beauvoir. Nogmaals welkom terug in de ambigue en daarmee subjectieve VUCA-wereld, waarin meer data met meer geavanceerde algoritmes voor het doen van voorspellingen niet automatisch leiden tot ethisch betere besluiten. De volgende casus zal dit overtuigend aantonen.

Casus uit de praktijk: de toeslagenaffaire

Over de toeslagenaffaire van de Belastingdienst is al veel gezegd. Tienduizenden gezinnen raakten jarenlang zwaar gedupeerd door onterechte fraudeverdenkingen met kinderopvangtoeslagen. Ze vonden telkens geen gehoor voor steeds groter wordende financiële en psychologische problemen. Na de recente erkenning van hun problematiek blijkt de compensatie van de geleden schade een nieuw struikelblok.

In de toeslagenaffaire blijken data en algoritmen een dubieuze te spelen, in de vorm van een zogenoemd risicoclassificatiemodel. De data waarmee dit model worden gevoed en de wijze waarop de risicoclassificatie tot stand komt is niet zichtbaar voor de gebruikers van dit model. De betekent bijvoorbeeld dat een ambtenaar niet kon weten welke informatie leidde tot een hoge risicoscore voor een aanvrager van de toeslag.

Dit hoge black box gehalte en de wijze waarop dit model is gebruikt is onlangs zeer kritisch beschouwd door Amnesty International, in het rapport Xenofobe Machines. De ondertitel is zo mogelijk nog veelzeggender: Discriminatie door ongereguleerd gebruik van algoritmen in het Nederlandse toeslagenschandaal. Dit maakt de toeslagenaffaire tot een tragische casus uit de VUCA-praktijk, met een hevige botsing tussen big data en ethiek.

Het risicoclassificatiemodel is een zogenoemd lerend algoritmisch besluitvormingssysteem, bedoeld voor de opsporing van onjuiste aanvragen en fraude. Met dit systeem werden vanaf 2013 door de Belastingdienst risicoprofielen opgesteld van de personen die een toeslag voor kinderopvang ontvingen. Via die risicoprofielen kon de Belastingdienst toetsen bij wie kans groter is dat zij ‘mogelijk onnauwkeurige aanvragen en wijzigingen indienen en potentieel fraude plegen’, aldus het Amnesty-rapport. Verder was er sprake van een perverse financiële prikkel: de kosten van het model moesten worden terugverdiend. Dit vertaalde zich in hoge boetes en het in één keer terugvorderen van enorme bedragen, terwijl huishoudens die in aanmerking komen voor toeslagen in het algemeen niet tot de grootverdieners van Nederland behoren.

Het gebruik van het black box risicoclassificatiemodel in combinatie met de prikkel om de kosten ervan terug te verdienen leidde tot veel ’vals positieven’. Tienduizenden ouders en verzorgers werden zo jarenlang ten onrechte beschuldigd van fraude met kinderopvangtoeslag. Het rapport van Amnesty trekt een dan ook een aantal niet mis te verstane conclusies over het toegepaste risicoclassificatiemodel. Neem dit citaat:

‘Het gebruik van het black box-systeem en het zelflerend algoritme belemmerde de transparantie en uitvoering van de verantwoordingsplicht en is daarom onverenigbaar met de beginselen van behoorlijk bestuur, legaliteit en de rechtsstaat.’

Of neem deze eindconclusie over etnisch profileren en daarmee over het nalaten van ethisch handelen:

‘De Belastingdienst heeft nagelaten om voorafgaand aan het gebruik van het risicoclassificatiemodel de risico’s en gevolgen voor de mensenrechten te beoordelen. Daarnaast heeft de Belastingdienst niet de risico’s beperkt om discriminatie als gevolg van het gebruik van het risicoclassificatiemodel te voorkomen.’

Hoe zijn dergelijke drama’s in de toekomst te voorkomen, terwijl zowel de hoeveelheid beschikbare data als algoritmen om daar voorspellingen mee te doen alleen maar zullen toenemen? Amnesty doet hiervoor een aantal aanbevelingen. Een daarvan is het afzien van het gebruik van black box-systemen in risicovolle situaties, zoals bij de opsporing van fraude in de sociale zekerheid. Ook wordt ervoor gepleit om zelflerende algoritmen te verbieden voor specifieke besluitvorming in de publieke sector. Denk hierbij aan besluitvorming die bijvoorbeeld de rechten en vrijheden van individuen aantast, of besluitvorming die een grote impact op de samenleving heeft. Daarbij is een zo groot mogelijke transparantie vereist over gebruik van algoritmische besluitvormings-systemen in de publieke sector. Die kan worden verkregen via een openbaar register met informatie over het gebruik van algoritmische besluitvormingssystemen in de publieke sector.

Met andere woorden: tussenkomst van de factor mens blijft van belang. Toch zijn dit allemaal vrij abstracte aanbevelingen, die een lange adem vergen om daadwerkelijk in de praktijk te worden gerealiseerd. Wat kunnen wij zelf op korte termijn – bijvoorbeeld vanaf morgen – bijdragen aan verantwoord en daarmee ethisch gebruik van data en algoritmen? Hoe kunnen wij zelf bijdragen om vermijdbare botsingen tussen data en ethiek te beperken? Om de inmiddels bewezen risico’s ervan tijdig en expliciet onder ogen zien, om die risico’s vervolgens tot algemeen aanvaarde proporties terugbrengen? Ofwel, wat vraagt dit alles van ons aan persoonlijk risicoleiderschap?

Risicoleiderschap als verbindende noodzaak?

Voor velen is risicomanagement waarschijnlijk een vrij bekend begrip. Het is een van de vele management disciplines om allerlei soorten risico’s te beheersen. Risicomanagement kan goed werken voor risico’s die kunnen optreden bij de eerder genoemde tamme, voorspelbare en daarmee beheersbare vraagstukken. Op de veel minder voorspelbare, complexe en meerduidige wilde vraagstukken loopt het gebruikelijke, op beheersing gericht risicomanagement stuk. Het wordt dan een papieren tijger waarmee vooral schijnzekerheden worden gegenereerd. Dergelijke wilde vraagstukken zijn immers niet volledig te voorspellen, laat staan te beheersen.

Daarom is voor het omgaan met de onzekerheden van wilde vraagstukken de laatste jaren een andere benadering in ontwikkeling, die van risicoleiderschap. Terwijl er al boekenkasten vol zijn geschreven over management en leiderschap is risicoleiderschap een nog vrijwel onontgonnen gebied. Op basis van recente literatuur over omgaan met risico’s en leiderschap in de VUCA-wereld kan risicoleiderschap worden gedefinieerd als het ERG doelgericht durven omgaan met onzekerheden en de daaruit volgende risico’s en kansen. ERG staat hierbij voor de woorden expliciet, realistisch en gestructureerd.

ERG omgaan met onzekerheden betekent bijvoorbeeld de onvermijdelijke perceptieverschillen bespreekbaar maken (expliciet), erkennen dat niet alle onzekerheden zijn te vermijden of te beperken (realistisch) en de drie zogenoemde DOD-vragen stellen (structuur). Deze DOD-vragen vormen de essentie van risicomanagement en kunnen in elk type overleg worden gesteld:

- Wat is het Doel?

- Wat is daarbij Onzeker?

- Wat daaraan al dan niet te Doen?

Zie doelen hierbij breed en op alle mogelijke organisatieniveaus. Doelen variëren van kernwaarden en strategische doelen, via divisie- en afdelingsdoelen, tot teamdoelen en bijvoorbeeld concrete (digitale) veiligheidseisen. Onzekerheden kunnen negatieve effecten op het doel hebben, als risico. Vaak wordt over het hoofd gezien dat onzekerheden ook positieve effecten op doelen kunnen hebben. Dit is met name interessant voor wilde vraagstukken met vele onzekerheden. Het wat al dan niet iets doen aan risico’s en kansen omvat bijvoorbeeld uit het nemen van preventieve maatregelen, voordat het risico of de kans is opgetreden. Met name in een onvoorspelbare VUCA-omgeving zijn vaak ook correctieve maatregelen van belang, om de gevolgen van eenmaal opgetreden en lastig te voorspellen risico’s te beperken.

Specifiek voor het beperken van botsingen tussen data en ethiek kan een aantal vaardigheden voor risicoleiderschap helpen. Dit zijn negen van die vaardigheden, die iedereen zich met wat inspanning eigen kan maken:

- Omgaan met conflicterende doelen: bijvoorbeeld het tegengaan van fraude versus een eerlijke, gelijke en rechtvaardige behandeling. Hiervoor zijn de kernwaarden van de organisatie leidend.

- Waarde(n) dominant maken: handelen vanuit ethische waarden krijgt zo voorrang op bijvoorbeeld het realiseren van financiele doelen.

- Variatie benutten: door het organiseren van diversiteit en het daardoor zien van perceptiesverschillen wordt bijvoorbeeld tunnelvisie of groepsdenken beperkt.

- Eigenaarschap ontwikkelen: wie is eigenaar van een risico en neemt de daaruit volgende (risico)besluiten? Een vuistregel: doelverantwoordelijkheid betekent ook verantwoordelijkheid voor de daaruit volgende onzekerheden, risico’s en kansen.

- Vertrouwen geven: in eerste instantie uitgaan van goede bedoelingen, zonder naïef te worden. In een voor veel mensen ingewikkelde wereld hoeft niet elke afwijking het gevolg te zijn van doelbewuste fraude.

- Onzekerheden toelaten: ethisch handelen vraagt om durven twijfelen, om niet zeker durven weten en dat ook uitspreken. Dit in de geest van Simone de Beauvoir: zonder mislukking geen moraal.

- Scherpe keuzes willen maken: bijvoorbeeld vanuit ethische waarden de grenzen aangeven én bewaken voor het verzamelen van data en de toepassing ervan in (zelf)lerende algoritmen.

- Afwijkingen tijdig opmerken: wanneer vliegen we uit de bocht en botsen onze big data toepassingen in algoritmen op onacceptabele wijze met onze ethische waarden?

- Vragen stellen: zijn we ethisch ofwel juist aan het handelen, en voor wie eigenlijk? Hierbij kunnen we de drie DOD-vragen als startpunt gebruiken: wat zijn onze ethische Doelen, wat is daarbij Onzeker en wat daaraan al dan niet te Doen?

Samenvattende tips

Hoe kunnen we het beperken van de botsingen van big data met ethiek nu samenvatten, vanuit een verbindende rol met risicoleiderschap? Een aantal concrete tips kan wellicht helpen. Begin met onderscheid tussen wilde van tamme vraagstukken en de bijbehorende onzekerheden, risico’s én kansen. Probeer wilde vraagstukken en de bijbehorende onzekerheden vervolgens niet aan te pakken met tamme benaderingen.

Beperk verder onze o zo menselijke en meestal onbewuste negatieve bias met het verzamelen e begrijpelijk presenteren van feitelijke data. Hans Rosling heeft het levenslang aangetoond: we zien het glas te vaak als halfleeg, terwijl we het met adequate feitelijke data minstens ook als halfvol kunnen zien. Dit maakt ons niet alleen minder angstig, het draagt ook bij aan overdreven risicomijding.

Aan de andere kant, erken ook de beperkingen van doorgeschoten ‘dataïsme’ en ‘tech for good’. Ongebreidelde dataverzameling en het gebruik ervan in black box-achtige zelflerende algoritmen heeft al meer dan genoeg ellende opgeleverd, zo leert ons alleen al de toeslagenaffaire. Daarbij blijft ethisch handelen altijd ambigu, verbonden met niet (zeker) weten en dus ook met onzekerheden.

Het ontwikkelen én toepassen van vaardigheden voor risicoleiderschap kan je hierbij wellicht helpen. Geef het daarom een kans. Risicoleiders zijn ongewoon gewone mensen, die steeds weer in staat zijn om risicogestuurd waarde te realiseren én te behouden, juist in een dynamische organisatieomgeving. In dit essay gaat het om nadrukkelijk om ethische waarden, die misschien wel het startpunt vormen voor alle andere waarden. Dus pak je voorbeeldrol, neem vandaag nog je verantwoordelijkheid en verbind data met ethiek, via jouw hoogstpersoonlijke risicoleiderschap!

Over de auteur

Dr. ir. Martin van Staveren MBA doceert, adviseert en schrijft over vernieuwende manieren van omgaan met onzekerheden, risico’s én kansen in organisaties. Hij is kerndocent risicomanagement, Universiteit Twente. Hij schreef de boeken Risicogestuurd werken (2015), Risicoleiderschap (2018) en Iedereen risicoleider: waardevolle doelen realiseren én behouden in een onzekere wereld (2020).

Bronnen

- Amnesty International (2021). Xenofobe machines: Discriminatie door ongereguleerd gebruik van algoritmen in het Nederlandse toeslagenschandaal. Ai indexnummer: eur 35/4686/2021, oktober 2021.

- Rasch, M. (2021). Frictie: Ethiek in tijden van dataïsme. De Bezige Bij, Amsterdam.

- Rosling, H, Rosling, O. & Rosling Rönnlund, A. (2018). Factfulness: Ten reasons we’re wrong about the world – and why things are better than you think. Sceptre, London.

- Rutten, R. (2021). Werden ze nou toch geprofileerd? NRC, 26 oktober 2021, pagina 11.

- Van Staveren, M.T. (2020). Iedereen risicoleider: Waarde realiseren én behouden in een onzekere wereld. Boom, Amsterdam.